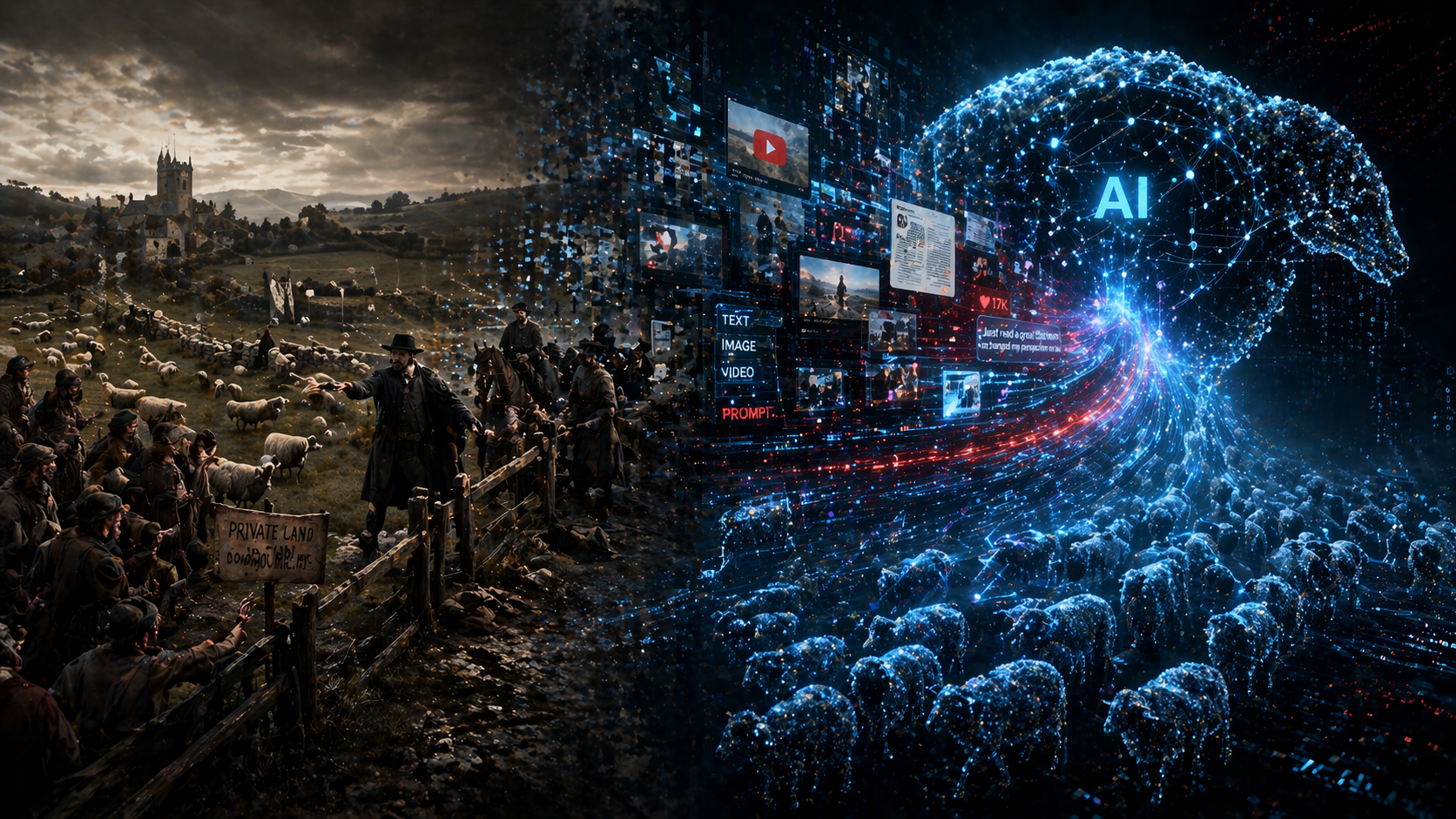

양이 사람을 잡아먹던 역사가

AI 시대에 반복되고 있다

“양이 사람을 잡아먹는다”

약 500년 전, 토마스 모어(Thomas More)는 자신의 저서 《유토피아(Utopia)》에서 충격적인 문장을 남겼다. “양이 사람을 잡아먹는다.” 비유가 아니었다. 당시 영국에서는 귀족들이 공유지에 울타리를 치고 양을 풀어놓으면서, 그 땅에서 농사를 짓던 수많은 평민들이 실제로 터전을 잃고 죽어갔다.

그런데 이 500년 전의 구조가 지금 AI 시대에 소름 끼칠 정도로 똑같이 반복되고 있다. 테크 기업들이 키우는 ‘AI’라는 양은 인간이 창작한 데이터를 먹고 자라며, 그 과정에서 창작자들은 자기도 모르게 자신의 경쟁자를 훈련시키고 있다. 역사의 반복 속에서 우리는 지금 어디에 서 있는가?

인클로저 운동 — 모두의 땅이 사유화되기까지

15세기 이전의 영국에서 ‘땅을 소유한다’는 개념은 지금처럼 당연하지 않았다. 땅은 바람이나 공기처럼 모든 생명체를 위해 존재하는 것이었다. 왕조차 땅을 ‘소유’했다기보다 ‘관리할 권리’를 가진 존재에 가까웠다. 왕이 귀족들에게 땅의 관리 권한을 나눠주면, 귀족들은 다시 평민들에게 농사를 짓게 했고, 수익을 함께 나눴다.

실제로 1626년, 유럽인들이 맨해튼에 살던 원주민과 땅 거래를 했을 때 지불한 금액은 약 60길더(Guilder), 현재 가치로 약 1,200달러(약 130만 원)에 불과했다. 원주민들은 ‘땅을 판다’는 개념 자체가 없었기에, 이를 ‘함께 나눠 쓰자’는 의미로 이해했다. 그만큼 토지 사유화(Land Privatization)는 근대적인 개념이다.

그런데 15세기가 되자 귀족들이 이상한 행동을 시작했다. 모두가 나눠 쓰던 공유지(Commons)에 울타리(Enclosure)를 치고 양을 풀기 시작한 것이다. 이유는 단순했다. 농사보다 양모(Wool) 산업의 수익률이 높았기 때문이다. 더 어이없는 것은, 일부 귀족들은 순전히 취미 목적으로 — 사냥터나 낚시터를 만들기 위해 — 땅을 사유화했다는 점이다.

모두의 것이었던 땅에 울타리를 치고, 그 땅을 같이 사용하던 사람들을 내쫓는 것. 이것이 인클로저 운동(Enclosure Movement)의 핵심이다. 듀크대학교 로스쿨의 제임스 보일(James Boyle) 교수는 현재의 웹서비스 시장을 보고 “이것은 제2의 인클로저다”라고 경고했다.

과거: 농사보다 양이 돈이 된다 → 공유지에 울타리를 침 → 농민을 내쫓음

현재: 인간 창작물보다 AI가 돈이 된다 → 데이터를 무단 학습 → 창작자를 대체

웹이라는 공유지, 그리고 상생의 시대

인터넷이라는 세상에도 땅이 있다. 바로 웹(Web)이다. 웹을 만든 팀 버너스리(Tim Berners-Lee)는 1993년 웹을 배포하면서 자신의 모든 권리를 내려놓았다. 무료로 공개하는 것이 인류에게 더 많은 가치를 제공할 거라고 믿었기 때문이다. 500년 전 땅에 소유권이 없었듯, 웹에도 소유권이 없었다.

웹이라는 무료 공유지 위에 구글, 페이스북, 유튜브 같은 플랫폼이 들어섰다. 이들은 사람들을 불러 모아 글을 쓰고, 그림을 그리고, 영상을 만드는 창작(Creation)을 할 수 있게 했다. 창작물을 보러 더 많은 사람이 모이면 광고 수익이 생기고, 그 수익의 일부는 창작자에게 돌아갔다. 과거 귀족과 농민이 상부상조했던 것과 완벽히 같은 구조다.

여기까지는 인클로저와 거리가 있다. 인클로저의 핵심은 ‘내쫓는 것’인데, 지금까지의 구조는 오히려 “들어와서 창작하세요, 같이 돈 벌어요”였으니까. 그렇다면 진짜 인클로저는 언제 시작되는가? 바로 AI가 수면 위로 떠오른 지금부터다.

양의 먹이 — AI는 무엇을 먹고 자라는가

구글의 제미나이(Gemini), 오픈AI의 ChatGPT, X의 그록(Grok), 앤트로픽의 클로드(Claude) — 이 AI 모델들은 사실상 테크 기업들이 키우는 ‘양’이다. 이 양들이 먹는 것은? 인간이 창작한 데이터다. 문제는 이 양들이 정확히 어디서, 어떻게, 얼마나 먹고 있는지 우리가 모른다는 점이다.

(타 AI 학습량과 맞먹음)

도서 수 (법원 판결 기준)

AI 저작권 소송 수

구글 — 보물 더미 위에 앉은 기업

2024년 뉴욕 타임즈 보도에 따르면, 유튜브에서 제작자들의 영상을 AI 학습용으로 활용하고 있다는 사실이 드러났다. 더 흥미로운 점은, 유튜브가 이후 크리에이터들에게 AI 학습 제외 기능을 제공했지만, 제외할 수 있는 기업 목록에서 구글은 빠져 있었다는 것이다. 일부 유튜버들은 자기도 모르게 AI 경쟁자를 훈련시키고 있었던 셈이다.

앤트로픽 — 안전의 아이콘, 그 이면

클로드를 만든 앤트로픽(Anthropic)은 트럼프 정부와의 계약 조건을 사람들의 안전을 이유로 거부하면서 긍정적 이미지를 얻었다. 하지만 소송을 통해 700만 건 이상의 책을 불법으로 다운로드해서 AI를 학습시킨 사실이 드러났다.

AI 기업들의 공통 입장: “저작권이 있는 자료를 활용해 새롭고 변형된 콘텐츠를 만드는 것이므로 공정 이용(Fair Use)에 해당한다. 저작권료를 강제하면 급성장 중인(burgeoning) AI 산업의 발목을 잡을(hamstring) 수 있다.”

영어 원문의 뉘앙스를 들여다보면 노골적이다. “Hamstring the burgeoning AI industry” — 저작권료를 내는 것이 급성장하는 혁신의 발목을 잡는 행위라니, 정당한 대가를 요구하는 창작자들이 마치 가해자인 것처럼 들린다.

공정 이용법 vs 머튼 조례 — 애매함이 무기가 될 때

과거 인클로저 때도 귀족들에게 유리한 법 조항이 있었다. 머튼 조례(Statute of Merton, 1236)다. 핵심은 단순했다: “목초지를 적당히만 남겨두면, 나머지는 귀족 마음대로 해도 된다.” 이 ‘적당히’라는 애매한 기준이 귀족들의 사유화 무기가 되었다.

🏰 머튼 조례 (1236)

🤖 공정 이용법 (§107)

현재 미국 저작권법 107조의 공정 이용(Fair Use) 성립 조건은 네 가지 요소를 종합적으로 판단한다.

| 요소 | 내용 | AI 기업 주장 |

|---|---|---|

| 1. 이용의 목적과 성격 | 상업적인가, 교육적인가, 변형적인가 | “학습 후 완전히 다른 결과물 → 변형적 사용” |

| 2. 저작물의 성격 | 사실 기반인가, 창작물인가 | “다양한 출처의 데이터를 혼합” |

| 3. 이용된 양과 비중 | 원작의 얼마를 사용했는가 | “전체를 학습하지만 개별 복제는 없다” |

| 4. 원작 시장에 미치는 영향 | 원작의 수요를 대체하는가 | ⚠ 판사들 간 의견 대립 |

앤트로픽은 이 논리로 법원에서 공정 이용을 인정받아 승소한 바 있다. 하지만 4번 요소 — 원작 시장에 미치는 영향 — 에서는 판사들의 견해가 갈리고 있다. AI가 원작 시장을 직접 대체한다고 판단한 사례에서는 기업이 패소했다.

2026년, 역사의 분기점

2026년은 AI 저작권의 운명을 가를 해다. 뉴욕 타임스가 오픈AI와 마이크로소프트를, 디즈니와 유니버셜이 미드저니를, 작가들이 메타·구글·애플을, 음악 회사들이 앤트로픽을 고소했다. 미국에서만 AI 기업 대상 저작권 소송이 50건을 넘으며, 올해 여름부터 본격적인 판결이 시작될 전망이다.

이 소송의 결과가 중요한 이유는 역사가 보여준다. 과거 인클로저는 1차와 2차로 나뉜다.

📍 1차 인클로저

💀 2차 인클로저

1차 인클로저에서는 공유지의 3%만이 사유화됐지만, 법이 귀족의 편에 선 이후에는 거의 모든 공유지가 사유화됐다. 핵심은 이것이다: 당시 의원들이 바로 땅을 관리하던 귀족들이었고, 자신들에게 유리한 법 4,000개 이상을 만들어 본격적으로 사유화를 밀어붙였다. 지금 테크 기업들도 이 역사를 누구보다 잘 알고 있다.

저항의 역사 — 반복되는 구조

전환기의 고통 속에서 저항하는 사람들을 잔인하게 응징하는 구조는 역사 속에서 소름 끼칠 정도로 똑같이 반복됐다.

사유화됨

기계 파괴

저항 진압

문명 발전

고통과 희생

인클로저 때 평민들은 얼굴을 까맣게 칠하고 귀족들이 세운 울타리를 부쉈다. 이에 대한 응징은 블랙 액트(Black Act) — 영국 역사상 가장 잔인한 법 중 하나였다.

사유화된 숲에서 사슴을 잡으면 사형. 나무를 베면 사형. 토끼를 잡으면 사형. 물고기를 잡으면 사형. 아무것도 훔치지 않았어도 얼굴을 가리고 있으면 사형. 처음 50개였던 사형 조건은 350개까지 늘어났고, 100년 가까이 지속됐다.

산업혁명 때도 같은 패턴이 반복됐다. 기계를 부수는 러다이트 운동(Luddite Movement)에 대해 프레임 브레이킹 액트(Frame Breaking Act)가 등장했고, 60~70명이 기계를 부쉈다는 이유로 목숨을 잃었다.

| 시대 | 저항 | 응징 법안 | 결과 |

|---|---|---|---|

| 15~18C 인클로저 | 울타리 파괴 (Blacks) | 블랙 액트 (Black Act) | 사형 조건 350개, 100년 지속 |

| 19C 산업혁명 | 기계 파괴 (Luddites) | 프레임 브레이킹 액트 | 60~70명 처형 |

| 빈민 문제 | 방랑·불황 | 방랑자 처벌법 | 1회 채찍, 2회 귀 뚫기, 3회 사형 |

| 21C AI 시대 | 저작권 소송 · 반AI 운동 | 진행 중… | 2026년이 분기점 |

기본 소득 vs 데이터 존엄성

인클로저와 산업혁명으로 터전을 잃은 빈민들이 넘쳐나자, 엘리자베스 1세 때 구빈법(Poor Law)이 시행됐다. 세금으로 궁핍한 사람들을 도와주는 법으로, 초기에는 사회 안정에 기여했다. 흥미롭게도, 이 개념은 지금 테크 CEO들이 말하는 기본 소득(UBI, Universal Basic Income)과 꽤 유사하다.

하지만 구빈법의 결말은 낙관적이지 않았다. 시간이 흐르며 “가만히 받아먹는 게으른 자들”이라는 여론이 형성됐고, 법이 개정되며 지원은 거의 사라졌다. 주는 쪽이 마음을 바꾸면, 받는 쪽은 아무것도 할 수 없다. 역사가 이미 보여줬다.

AI로 인해 발생하는 사회적 문제를 해결하기 위해 UBI를 주장하는 건 매우 위험한 생각이다. AI의 정체성을 지키기 위해 인간을 모두 빈민으로 만드는 거다. 왜 인간을 창조하는 존재가 아니라 의존적인 존재로 만들려 하는가?

재론 레니어는 기본 소득 대신 데이터 존엄성(Data Dignity)이라는 개념을 제안했다. AI에게 유용한 데이터를 제공하는 대가로 정당한 보상을 받는 구조 — 모두가 기본 소득을 받으며 스스로를 쓸모없다고 느끼는 미래가 아니라, 인간이 가치를 창출하고 그에 대한 대가를 받는 미래를 만들자는 것이다.

💰 기본 소득 (UBI)

🛡️ 데이터 존엄성 (Data Dignity)

에모리 대학교의 연구에서 흥미로운 결과가 나왔다. AI 소비자들에게 “원작자에게 보상이 돌아간다는 걸 안다면 더 많은 돈을 내겠습니까?”라고 물었을 때, 사람들은 더 많은 돈을 내겠다고 답했다. 심지어 일회성이 아니라 사용할 때마다 원작자에게 돈이 가는 구조를 더 선호했다.

이런 수요를 실제 사업으로 만든 사람도 있다. 스테이블 오디오(Stable Audio)를 이끌던 에드 뉴턴렉스(Ed Newton-Rex)는 기존 아티스트들의 데이터를 무단으로 학습하는 AI 산업에 회의감을 느끼고 퇴사한 뒤, 아티스트의 창작물을 정당하게 사용하는 AI 기업을 인증하는 비영리 단체 Fairly Trained를 시작했다.

고립과 외로움 — AI가 파고드는 인간의 균열

전 세계적으로 한 시간에 약 100명이 외로움으로 인해 목숨을 잃는다. 한국에서는 2024년 고립·은둔 청년 비율이 2년 전 대비 두 배 이상 증가했고, 고립된 청년의 75%가 자살을 생각해 본 적이 있으며, 그중 26%가 실제로 시도했다.

전 세계 사망 추정

(2022→2024)

전 세계 사용자 (5년간)

자살 생각 경험 비율

인간이 고통을 견디기 위해 같은 인간이 아니라 AI에게로 향하고 있다. 지난 5년간 전 세계적으로 AI와 친밀한 관계를 맺은 사용자가 10억 명을 돌파했다. 많은 사람들이 “사람보다 AI가 대화가 더 잘된다”고 말한다. 효율이나 지능뿐만 아니라 인간성(Humanity) 면에서도 AI에게 지고 있는 것일까?

AI와의 친밀한 관계가 인간에게 항상 좋은 결과를 낳는가? AI 기업들은 사용자의 의존성이 높아질수록 수익이 늘어나는 구조다. 외로움의 해결이 아니라, 외로움의 상업화가 아닌지 되물어야 한다.

내부자들의 경고 — “세계는 위험에 처해 있다”

AI의 위험성에 대한 경고가 내부에서 쏟아지고 있다. OpenAI 공동 창립자 지미 바(Jimmy Ba)는 퇴사하며 “2026년은 우리 종의 미래에 있어 가장 바쁘고 중요한 해가 될 것”이라고 경고했다. 실리콘 밸리의 유명 투자자는 이렇게 말했다: “AI와 관련해서 이렇게 많은 기술자들이 이토록 강하게, 자주, 그리고 이토록 심각하게 우려를 표명하는 걸 본 적이 없다.”

세계는 위험에 처해 있습니다. 세계에 영향을 미치는 우리의 기술적 능력만큼 지혜도 함께 자라야 하는 시점에 와 있습니다. 그렇지 못하면 인간은 그 대가를 치르게 될 겁니다.

여기서 일하는 동안 가치관대로 행동하는 게 얼마나 어려운 일인지 반복해서 봐왔습니다. 나 자신도, 조직도, 사회도 — 정작 가장 중요한 건 뒤로 미루고 다른 것들을 선택하게 되는 압박 속에 있었습니다.

이 흐름을 바꾸기 어려운 이유는 너무나 많은 이해관계가 걸려 있기 때문이다.

인간은 구조적 약자가 아니라 구조적 강자다

AI 기업들이 정말 숨기고 싶어하는 사실이 있다. 아직은 이 판에서 인간이 엄청나게 강력한 구조적 강자라는 것이다.

오픈AI의 CFO가 직접 공개한 수익 구조는 명확하다. 주된 수익은 다양한 등급의 구독료와 API 사용료 — 전부 인간이 ChatGPT를 사용하며 지불하는 돈이다. Nature에 실린 연구가 보여주듯, AI는 학습을 위해 인간이 만든 고품질 데이터가 필수적이다. 데이터를 공급하는 것도 인간, 수익을 만들어주는 것도 인간이다.

골드만삭스(Goldman Sachs)도 보고서를 통해 지적했다. “AI 기술이 기업과 사회를 변혁시킬 거라는 기대 아래 약 1조 달러의 자본이 투입될 것으로 예상되지만, 지금까지 이 지출이 보여준 성과는 거의 없다.”

얼마 전 ChatGPT에서 인간 수요가 급감한 사건이 있었다. 앱 삭제가 하루 만에 295% 급증하고 다운로드는 13% 감소하자, 샘 알트먼은 주말에 다급하게 해명문을 올렸다. AI 기업들은 인간의 눈치를 매우 볼 수밖에 없는 구조다.

인간만큼의 인공지능(AGI)에 도달하기까지의 타임라인은 전문가마다 2년에서 10년 이상까지 천차만별이다. 가장 급진적인 예측이 2년이라면, 최소 2년은 인간이 구조적으로 유리한 판이다. 이 시간을 어떻게 쓰느냐가 역사의 반복을 결정한다.

두 가지 변수 — 이번엔 다를 수 있는 이유

이 글은 희망찬 마음만으로 쓰인 것이 아니다. 하지만 500년 전과 결정적으로 다른 두 가지 변수가 있다.

역사상 최고치

정보 접근 + 빠른 응집력 +

높은 교육 수준 = 구조 파악 가능

AI는 인간의 데이터와 돈이 필수

아직 AGI까지 최소 2년

지금은 인간이 유리한 판

첫 번째 변수: 테크 기업 CEO들이 간과하는 것이 있다. 그들이 리드한 기술의 발전으로 지금 사람들은 그 어느 때보다 손쉽게 다양한 정보에 접근할 수 있게 되었고, 그 어느 때보다 빠르게 응집할 수 있게 됐다. 높은 교육 수준으로 인간들은 그 어느 때보다 똑똑해졌다. 이 똑똑한 인간들이 기술을 등에 업고 역사 속에서 반복되는 구조를 파악해내고, 그에서 벗어나기로 선택한다면 판이 크게 바뀔 수 있다.

두 번째 변수: 앞서 분석했듯, 인간은 현재 구조적 약자가 아니라 구조적 강자다. AI 기업들의 수익 구조는 전적으로 인간에게 의존하고 있으며, 인간의 고품질 데이터 없이는 다음 단계의 AI도 만들 수 없다.

사람들은 나쁜 일이 일어나는 걸 생각하기 싫어해서 그 가능성을 항상 과소 평가한다.

AI로 벌어질 수 있는 나쁜 가능성을 외면하면 득을 보는 건 아주 소수다. 고통을 마주하고 공포를 직면하면 결국 이 문제를 혼자서는 해결할 수 없다는 자각이 든다. 그 자각이 인간을 뭉치게 만들 것이고, 역사적으로 인간은 그렇게 살아남아 왔다.

특정 소수가 아니라 대중이 집단의 미래를 결정하는 데 훨씬 더 강한 발언권을 가져야 한다. 인클로저 때는 소수의 편에 섰던 법과 정치 권력을 다수의 편으로 만드는 데 성공해야 한다.

역사는 반복되지만, 결말은 우리가 쓴다

500년 전 양이 사람을 잡아먹던 구조와 지금 AI가 인간의 창작물을 삼키는 구조는 소름 끼칠 정도로 닮았다. 공유지의 사유화, 법의 편향, 저항과 응징, 그리고 전환기의 고통 — 역사는 반복되고 있다.

하지만 이번에는 다를 수 있다. 500년 전과 달리, 지금의 인간은 정보에 접근할 수 있고, 빠르게 응집할 수 있으며, 역사의 패턴을 읽을 수 있다. 무엇보다 아직은 인간이 이 판의 구조적 강자다.

인클로저와 산업혁명이 진행되는 수백 년 동안 너무 많은 사람들이 죽고 고통받았다. 그 고통의 시간을 줄이기 위해 필요한 것은, 서로를 이해하고 신뢰하고 함께하는 인본주의적 가치다. AI를 두고 인간끼리 싸우는 것이 아니라, 화합하는 예상치 못한 변수를 만들어내야 한다.

그리고 혹시 성공하지 못하더라도 — 그런 시도를 한 인간들이 존재했다는 사실 자체가 위로가 되기를 바란다.

답글 남기기